Ein Beitrag von Cristiano Gomes, Portfoliomanager FOCAM AG: Die Märkte preisen eine Softwarerevolution ein, deren Früchte reale Investitionsrenditen voraussetzen. Was dabei zu selten in Bewertungsmodelle einfließt: Die entscheidenden Engpässe der nächsten Jahre entstehen nicht im Code, sondern in Kupferminen, Transformatorenwerken und Genehmigungsbehörden. Für Anleger, die den KI-Megatrend investierbar machen wollen, stellt sich damit weniger die Frage, welche Technologie sich durchsetzt, als vielmehr, welche physischen Voraussetzungen dafür erfüllt sein müssen – und wer sie kontrolliert.

Die Zeitasymmetrie: Warum das Kapital der Realwirtschaft vorauseilt

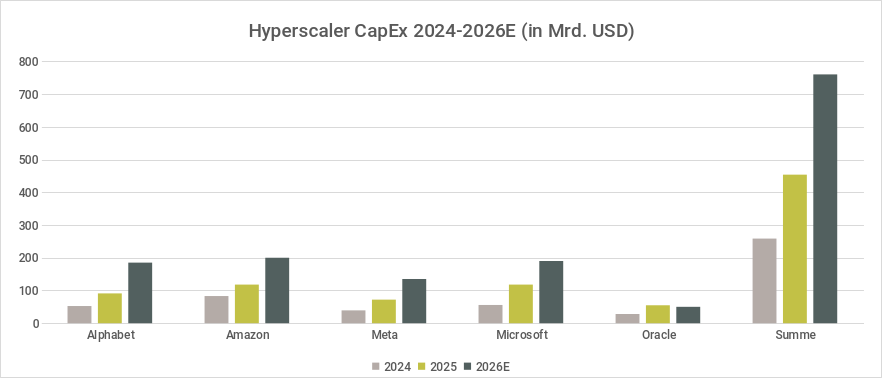

Die These der Produktivitätssteigerung durch künstliche Intelligenz ist analytisch intakt. Die neueste Penn Wharton Budget Model-Studie erwartet einen dauerhaft um 1,5 Prozent höheren BIP-Stand bis 2035, und die Cloud-Wachstumsraten der Hyperscaler (z.B. Amazon Web Services +28 Prozent, Google Cloud +63 Prozent im ersten Quartal 2026 im Jahresvergleich) zeigen, dass die Nachfrage auf echter Nutzung beruht. Goldman Sachs Asset Management beziffert die kombinierten Capex-Pläne der Hyperscaler für 2026 auf mehr als 750 Milliarden Dollar, während direkte KI-Dienstleistungserlöse bislang bei rund 25 Milliarden Dollar liegen. Auf gesamtwirtschaftlicher Ebene lassen sich belastbare Produktivitätseffekte statistisch noch nicht messen – ein Befund, der mit dem typischen Diffusionszyklus von Basistechnologien übereinstimmt.

Quelle: SEC-Filings (10-K/10-Q/8-K) und Unternehmens-Guidance von Alphabet, Amazon, Meta, Microsoft und Oracle; Goldman Sachs Asset Management (2026), Investing in the Architecture of AI’s Future. Eigene Darstellung.

Die Eisenbahn, die Elektrizität, das Internet benötigten jeweils 15 bis 30 Jahre, bis sich ihre Wirkung in Produktivitätskennzahlen niederschlug, wobei die Investitionswelle der Ertragswelle stets vorauseilte. Die physische Lieferkette, die diese Revolution trägt, operiert auf Zeitachsen, die der Kapitalmarkt in seiner Bewertung bislang weitgehend ausblendet – und genau darin liegt das investmentrelevante Kernproblem.

Die KI-Lieferkette: Vier physische Schichten bestimmen das Wachstum

Die KI-Infrastruktur lässt sich in vier physische Schichten aufteilen – Rohstoffe, Geopolitik, Chiptechnologie und Energie -, von denen jede eine eigene Zeitdynamik besitzt und in jeder dieselbe Grundfrage aufgeworfen wird: Wie schnell kann das Angebot auf eine Nachfrage reagieren, die sich innerhalb weniger Quartale vervielfacht?

Rohstoffe – Kupfer als materielles Fundament der KI-Cloud

Künstliche Intelligenz beginnt nicht in der Cloud, sondern im Boden. Ein modernes Rechenzentrum benötigt Kupfer in industriellem Ausmaß: für Hochspannungsleitungen, Mittelspannungskabel, Sammelschienen, Kühlpumpen und Transformatoren. Laut einer Analyse der International Energy Agency (IEA) aus dem Jahr 2025 beläuft sich der Kupferbedarf allein für die globale Rechenzentrumsinfrastruktur bis 2030 auf rund 512.000 Tonnen, was etwa zwei Prozent der gesamten heutigen Jahresproduktion entspricht. In den Beschaffungsabteilungen der großen Baukonsortien ist Kupfer längst das meistdiskutierte Engpassmaterial.

Nach Daten von S&P Global dürfte die Kupfernachfrage bis 2040 um 50 Prozent auf 42 Millionen Tonnen jährlich steigen, während das projizierte Angebotsdefizit bis dahin 10 Millionen Tonnen erreichen könnte – ein „systemisches Risiko für globale Industrien, technologischen Fortschritt und Wirtschaftswachstum”, wie Daniel Yergin, Vizechairman von S&P Global, im Januar 2026 formulierte. Die IEA kommt in einer gesonderten Mineralienanalyse zu dem Befund, dass bestehende und geplante Minen bis 2035 nur rund 70 Prozent der dann benötigten Kupfermenge bereitstellen können.

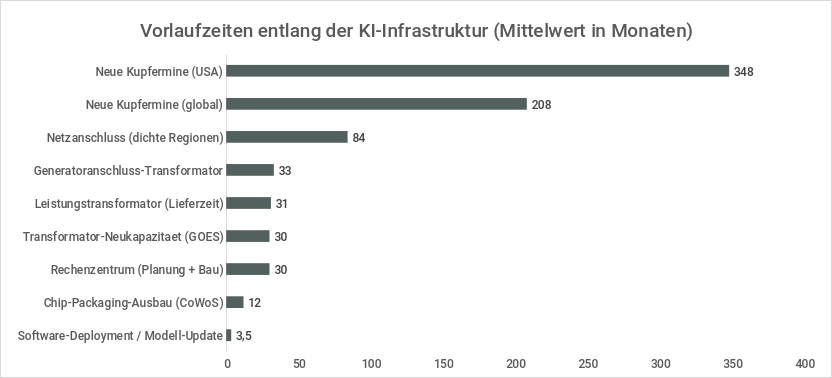

Das grundlegende Problem ist zeitlicher, nicht geologischer Natur. S&P Global Market Intelligence hat auf Basis von 268 analysierten Minen ermittelt, dass Projekte, die zwischen 2020 und 2023 in Betrieb gingen, im Schnitt knapp 18 Jahre von der Entdeckung bis zur Produktion benötigten – in den USA beträgt dieser Zeitraum im Schnitt 29 Jahre. Jede Mine, die heute auf steigende Nachfrage reagieren soll, liefert damit frühestens in den 2040er Jahren. Energiewende, Elektromobilität und KI-Infrastruktur konkurrieren dabei um dieselbe begrenzte Ressource, ohne dass eine der drei Nachfrageseiten Priorität hätte.

Geopolitik – Pekings Griff nach kritischen Mineralien

Neben Kupfer hängt die Halbleiterfertigung von einer Reihe weiterer Materialien ab, deren Förderung und Verarbeitung geografisch extrem konzentriert sind. Laut einer aktuellen IEA-Studie kontrolliert China durchschnittlich rund 70 Prozent der globalen Verarbeitungskapazitäten bei 19 von 20 strategischen Mineralien. Seit Dezember 2024 hat Peking schrittweise Exportbeschränkungen auf Gallium, Germanium, Antimon, Wolfram, Tellur und sieben schwere Seltenerdelemente gegenüber den Vereinigten Staaten verhängt – Materialien, die in Hochleistungsprozessoren, energieeffizienter Elektronik und den Permanentmagneten von Kühlsystemen unverzichtbar sind. Die Galliumpreise außerhalb Chinas haben sich seit Einführung der ersten Beschränkungen im Jahr 2023 mehr als verdoppelt. Insgesamt unterliegen inzwischen mehr als die Hälfte der energierelevanten kritischen Mineralien irgendeiner Form von Exportkontrolle – ein geopolitischer Aufschlag auf die Entstehungskosten westlicher KI-Infrastruktur, der in keiner Standard-Discounted-Cashflow-Rechnung auftaucht.

Halbleiter – Warum die Chip-Packaging-Krise absehbar endet

Der Chip-Engpass ist die Schicht, über die am meisten diskutiert wird, und gleichzeitig diejenige, die sich am schnellsten auflöst. Der limitierende Faktor war in den vergangenen Jahren nicht die Fertigung des Siliziums selbst, sondern der nachgelagerte Verpackungsprozess – CoWoS (Chip-on-Wafer-on-Substrate) -, der Recheneinheit und Hochbandbreite-Speicher zu einem funktionsfähigen KI-Beschleuniger verbindet. TSMC reagiert mit einer Verdreifachung der CoWoS-Kapazität von rund 35.000 auf 130.000 Wafer pro Monat bis Ende 2026 und adressiert damit unmittelbar den bindenden Flaschenhals. Diese Packaging-Kapazität lässt sich in Quartalen ausweiten, nicht in Jahren – der entscheidende Unterschied zu den physischen Engpässen der übrigen Schichten. Die verbleibende Restriktion verschiebt sich damit auf die vorgelagerte Waferfertigung, wo der 3-Nanometer-Knoten nach Analyse von Silicon Analysts bis mindestens Ende 2026 ausgebucht bleibt.

Im Speichermarkt hatte SK Hynix seine HBM-Kapazität für 2026 bereits Mitte 2025 vollständig vergeben, während Samsung im April 2026 signifikante Engpässe bis mindestens 2027 ankündigte. HBM (High Bandwidth Memory) bezeichnet gestapelte Hochleistungsspeicherchips, die in KI-Beschleunigern wie Nvidias GPUs verbaut werden und deren Rechenleistung erst nutzbar machen – ohne ausreichend HBM ist kein KI-Training und entsprechend kein Inferenzbetrieb möglich. Für Anleger bleibt die Chip-Schicht dennoch die konstruktivste der vier: Die Investitionen fließen, die Richtung ist klar, und die Auflösung ist absehbar – was sie von den übrigen Engpässen grundlegend unterscheidet.

Energie und Transformatoren – Wenn Netzanschlüsse zum strategischen Flaschenhals werden

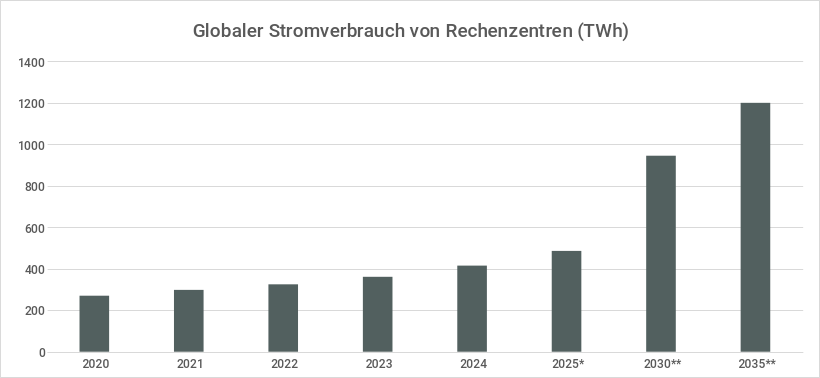

Goldman Sachs Commodities Research projiziert in einer Analyse von Mai 2026, dass der US-amerikanische Rechenzentrumsstrombedarf von 31 Gigawatt im Jahr 2025 auf 41 Gigawatt in 2026 und 66 Gigawatt in 2027 steigen wird – womit Rechenzentren bis 2027 auf einen Anteil von 8,5 Prozent an der US-Spitzenlast kämen. Das World Economic Forum hält in einem Bericht vom Mai 2026 fest, dass Netzanschlüsse in dicht besiedelten Regionen vier bis zehn Jahre in Anspruch nehmen, während KI-Rechenzentren typischerweise innerhalb von zwei bis drei Jahren geplant und gebaut werden. Diese Zeitlücke entscheidet zunehmend darüber, welche Projekte realisiert werden und welche scheitern, unabhängig von verfügbarem Kapital. Global zeichnet die IEA dieselbe Dynamik: Der Stromverbrauch der Rechenzentren dürfte sich von rund 415 Terawattstunden im Jahr 2024 auf etwa 945 Terawattstunden bis 2030 mehr als verdoppeln – ein Zuwachs in der Größenordnung des gesamten heutigen japanischen Stromverbrauchs.

Quelle: International Energy Agency (2025), Energy and AI; IEA (2026), Key Questions on Energy and AI. Eigene Darstellung.

*Eigene Berechnung auf Basis von Daten der IEA (2026); **Projektionen der IEA (2025)

Die physischen Engpässe innerhalb des Energiesystems sind dabei konkreter als die öffentliche Diskussion wahrnimmt. Hochspannungstransformatoren – das Verbindungsstück zwischen Übertragungsnetz und Rechenzentrum – haben laut IndustrialSage durchschnittliche Lieferzeiten von 128 Wochen für Leistungstransformatoren und 144 Wochen für Generatoranschlusstransformatoren erreicht; für Großanlagen berichten Branchenbeobachter von bis zu vier Jahren. Nach Daten von Wood Mackenzie ist die Nachfrage nach Generatoranschlusstransformatoren seit 2019 um 274 Prozent gestiegen, bei Leistungstransformatoren um 116 Prozent, während die Preise um 77 Prozent stiegen. Hinter dieser Knappheit verbirgt sich ein weiteres Konzentrationsproblem: Grain-Oriented Electrical Steel, das spezialisierte Kernmaterial jedes Leistungstransformators, wird in den USA ausschließlich von einem einzigen Produzenten hergestellt – Cleveland-Cliffs. Neue Kapazitäten aus dem laufenden Investitionsprogramm von rund zwei Milliarden Dollar stehen frühestens im Jahr 2028 zur Verfügung.

Das PJM-Interconnection, der größte regionale Strommarkt der USA mit mehr als 67 Millionen versorgten Einwohnern in 13 Bundesstaaten und dem District of Columbia, konnte im Dezember 2025 erstmals in seiner Geschichte eine Kapazitätsauktion nicht vollständig abschließen, weil die Nachfrage die verfügbaren Reserven um 6.625 Megawatt überstieg – ein Indikator dafür, dass das Netz bereits heute unter einem Lastdruck steht, der für diese Auslegung nicht vorgesehen war.

Die Zeitasymmetrie zwischen Kapitalmarkt und Realwirtschaft

Allen vier Schichten liegt dasselbe Grundproblem zugrunde: Kapitalmärkte diskontieren Erwartungen in Echtzeit, während Kupfermarkt, Stromnetz und Genehmigungsbehörde teilweise auf Jahrzehnte-Zeitachsen operieren. Goldman Sachs Asset Management hält fest, dass der kombinierte EBIT von Chips, Fertigung, Speicher und Servern das Neunfache des Wertes im Energiebereich beträgt – eine Bewertungsasymmetrie, die voraussetzt, dass die Knappheit im Energiebereich als vorübergehend einzustufen ist. Ob diese Einschätzung trägt, hängt weniger von Investitionsvolumen als von physikalischen und institutionellen Gegebenheiten ab, die sich unter Kapitaldruck nicht beschleunigen lassen.

Manche Engpässe, insbesondere in der Chip-Packaging-Schicht, sind kapitalintensiv, aber prinzipiell innerhalb von 12 bis 24 Monaten lösbar. Andere – neue Kupferminen mit knapp 18 Jahren Vorlaufzeit im globalen Schnitt und 29 Jahren in den USA, Übertragungsnetze mit Genehmigungsverfahren über mehrere Wahlperioden, Transformatorenkerne aus dem einzigen verbleibenden US-Produzenten – gehorchen anderen Gesetzmäßigkeiten.

Quelle: S&P Global Market Intelligence (2024); IndustrialSage (2026); World Economic Forum (2026). Eigene Darstellung.

Wertschöpfung wandert – der konstruktive Blick

Die Analyse mündet nicht in einer pessimistischen These, sondern in einer präzisen Transformation der Frage: Nicht ob KI produktiv wird, sondern wer die Knappheitsrente kassiert, solange die physische Infrastruktur der Nachfrage hinterherläuft. Für Anleger, die KI-Aktien gezielt einsetzen wollen, verschiebt sich damit die Analyse von der Modell-Ebene auf die Lieferketten-Ebene.

Die erste Phase der KI-Rally hat Halbleiterhersteller, Cloud-Plattformen und Modell-Entwickler belohnt. Diese Phase ist nicht abgeschlossen, hat aber an Einseitigkeit verloren. Goldman Sachs Asset Management benennt „physical enablers” als nächsten Profitpool und argumentiert, dass Energieinfrastruktur am Markt systematisch unterbewertet ist weil Investoren unterschätzen, wie schwer sie durch andere Technologien ersetzbar ist.

Unternehmen mit Preissetzungsmacht bei der Energieinfrastruktur – Leitungsnetze, Transformatoren, Schaltanlagen – stehen vor einer Nachfragewelle, die Goldman Sachs auf mehr als 750.000 benötigte neue Fachkräfte in der Stromversorgungs- und Netzbranche bis 2030 quantifiziert, gedeckt durch unterschriebene Capex-Pläne der größten Technologieunternehmen der Welt. Rohstoffproduzenten, die Kupfer oder andere kritische Materialien mit langen Anlaufzeiten fördern, profitieren von einem Angebotsdefizit, das sich über den mittelfristigen Betrachtungszeitraum nicht schließen wird – BHP hat diesen Zusammenhang in einer Analyse aus Januar 2025 explizit auf die KI-Infrastruktur als Nachfragetreiber verwiesen. Unternehmen mit proprietären Daten und physischer Substanz – die im März-Artikel dieser Reihe beschriebenen europäischen Profiteure der Pharma-, Rückversicherungs- und Finanzinfrastruktur-Industrie – werden durch die Engpass-Analyse gestärkt, weil sie KI nutzen können, ohne auf das Timing der Infrastrukturwelle angewiesen zu sein.

Portfoliokonsequenzen

Für die Portfoliokonstruktion ergeben sich drei operative Einsichten:

- Bewertungsrisiko differenzieren.

Cloud-Infrastruktur mit bestehenden Umsätzen und nachweisbarem Wachstum ist anders zu beurteilen als Softwarewerte, deren Produktivitätsversprechen auf einer gesellschaftsweiten KI-Diffusion beruht, die noch aussteht. Die relevante Frage ist nicht, ob man KI-Exponierung anstrebt, sondern an welcher Stelle der Wertschöpfungskette und zu welchem Preis. - Physische Knappheit als eigenständiges Investmentthema.

Die Kategorie KI-Infrastruktur-Aktien ist zu eng gefasst, wenn sie nur auf Technologieunternehmen angewendet wird. Elektrische Infrastruktur, kritische Rohstoffe und dezentrale Energieerzeugung nahe Rechenzentren sind systemrelevante Bestandteile einer KI-exponierten Volkswirtschaft – und konzeptionell eine Verlängerung des Debasement-Themas aus der April-Ausgabe dieser Reihe: Sachwerte mit begrenztem Angebot und wachsender Nachfrage schützen nicht nur vor Geldentwertung, sondern bilden auch den materiellen Unterbau der digitalen Revolution. - Zeithorizont aktiv managen.

Chip-Engpässe lösen sich binnen 12 bis 24 Monaten auf und stellen kurzfristige Impulse für Technologielieferanten dar. Engpässe bei Energieinfrastruktur und Rohstoffen erstrecken sich teils über Jahrzehnte. Portfolios, die beide Zeitachsen abbilden, sind robuster gegenüber dem Szenario, in dem die KI-These zwar intakt bleibt, die Marktführerschaft aber von Ebene zu Ebene wandert.

FAQ

Wenn der KI-Boom so kapitalintensiv ist – spricht das nicht gegen ein Investment?

Nein. Die Nachfrage nach KI ist real, und die Wachstumsraten der großen Cloud-Anbieter belegen das. Der Punkt ist ein anderer: Innerhalb eines Trends verschiebt sich, wer das Geld verdient. Als die Eisenbahn aufkam, profitierten zuerst die Lieferanten von Stahl, Schienen und Kohle – die Bahngesellschaften selbst erst viel später. Bei der KI deutet vieles darauf hin, dass die nächste Phase weniger den Software- und Chip-Werten gehört, deren Kurse bereits viel vorweggenommen haben, sondern den Zulieferern der physischen Infrastruktur: Stromnetze, Transformatoren, Kupfer.

Warum wird Strom für Rechenzentren zum dauerhaften Engpass und nicht nur zu einem vorübergehenden?

Weil sich der Bau eines Rechenzentrums und der Ausbau des Stromnetzes auf völlig unterschiedlichen Zeitachsen bewegen. Ein Rechenzentrum steht in zwei bis drei Jahren – der Anschluss an das Stromnetz dauert in dicht besiedelten Regionen vier bis zehn Jahre. Diese Lücke lässt sich nicht mit Geld schließen, sondern nur mit Zeit: Genehmigungen, Netzausbau und Bau folgen ihrem eigenen Takt. Wie angespannt die Lage schon heute ist, zeigt der größte US-Strommarkt PJM, der über 67 Millionen Menschen versorgt: Ende 2025 konnte er erstmals in seiner Geschichte eine Stromauktion nicht vollständig bedienen.

Warum kann ein höherer Kupferpreis den Mangel an Kupfer nicht einfach beheben?

Weil der Engpass nicht beim Geld liegt, sondern bei der Zeit. Eine neue Kupfermine braucht von der Entdeckung bis zur Förderung weltweit im Schnitt knapp 18 Jahre, in den USA sogar rund 29 Jahre. Ein höherer Preis verkürzt das kaum – Genehmigungsverfahren, geologische Erschließung und der physische Aufbau einer Mine lassen sich nicht beliebig beschleunigen. Erschwerend kommt hinzu, dass Energiewende, Elektromobilität und KI-Rechenzentren gleichzeitig um dasselbe Kupfer konkurrieren.

KI-Software wird ständig effizienter – sinkt damit nicht auch ihr Stromverbrauch?

Pro Aufgabe ja, in der Summe nein. Die Technik wird tatsächlich rasch sparsamer – der Stromverbrauch je KI-Aufgabe sinkt laut Internationaler Energieagentur Jahr für Jahr spürbar. Das Problem: Die Nutzung wächst schneller, als die Effizienz zunimmt, sodass der Gesamtverbrauch trotzdem steigt. Dieses Muster – Effizienzgewinne, die durch Mehrnutzung mehr als aufgezehrt werden – ist in der Energiewirtschaft seit dem 19. Jahrhundert bekannt und wird in der volkswirtschaftlichen Literatur Jevons-Paradoxon genannt.

Was hat KI-Infrastruktur mit dem Schutz vor Geldentwertung zu tun?

Beide Themen führen zur selben Anlageklasse. Sachwerte mit knappem Angebot – etwa Kupfer, Stromnetze oder Energieinfrastruktur – schützen traditionell vor der Entwertung des Geldes. Genau diese Sachwerte sind zugleich das materielle Fundament der KI. Wer aus Sorge vor Geldentwertung ohnehin über knappe Sachwerte nachdenkt, findet in der KI-Nachfrage ein zweites, unabhängiges Argument für dieselbe Richtung. Die Perspektive-Ausgabe vom April hat den ersten Teil dieses Gedankens – Sachwerte als Schutz vor Geldentwertung – ausführlicher behandelt.

Quellen

BHP. (2025). Why AI tools and data centres are driving copper demand. BHP Group.

Goldman Sachs Asset Management. (2026). Investing in the architecture of AI’s future. Goldman Sachs.

Goldman Sachs Commodities Research. (2026). US data center power demand projected to double by 2027. Goldman Sachs.

Goldman Sachs Insights. (2025). The power industry may need more than 750,000 new workers by 2030. Goldman Sachs.

International Energy Agency. (2024). Global critical minerals outlook 2024. IEA.

International Energy Agency. (2025). Energy and AI. IEA.

International Energy Agency. (2025). Global critical minerals outlook 2025. IEA.

International Energy Agency. (2026). Key questions on energy and AI. IEA.

IndustrialSage. (2026). Power transformer lead times hit 128 weeks in 2026. IndustrialSage.

Penn Wharton Budget Model. (2025). The projected impact of generative AI on future productivity growth. University of Pennsylvania.

PV Magazine USA. (2026). U.S. transformer market faces severe supply constraints as lead times extend to four years. PV Magazine.

S&P Global. (2026). Copper in the age of AI: Challenges of electrification. S&P Global.

S&P Global Market Intelligence. (2024). Mine development times: United States ranks next to last. S&P Global.

S&P Global Market Intelligence. (2024). Average lead time almost 18 years for mines started in 2020–23. S&P Global.

Silicon Analysts. (2026). TSMC foundry allocation status Q1 2026. Silicon Analysts.

Wood Mackenzie. (2025). Mind the gap: Tackling supply chain challenges in the electric T&D sector. Wood Mackenzie.

World Economic Forum. (2026). Is power grid connectivity the strategic bottleneck for AI? WEF.

Bilder © FOCAM AG